인공지능 인사이트 에디토리얼 팀의 2026년 실측 벤치: GPT-4o와 Claude3의 인퍼런스 비용·지연시간·토큰 품질을 실제 워크로드 기준으로 비교해, 비용 최적화 전략을 제시한다.

- 대규모 실무 워크로드(고빈도 Q&A·RAG·일괄 처리)에서 비용·지연·품질의 현실적 트레이드오프

- 1백만 토큰 단위 기준 실사용 비용 시나리오와 병목 포인트(네트워크/컨텍스트 크기/동시성)

- 운영에서 즉시 적용 가능한 비용 절감 가이드(프리프로세싱, 라우팅, 모델 크기 선택)

실무자로 본 GPT-4o·Claude3 인퍼런스 체감 — A씨와 B씨 이야기로 풀어보기

매일 엑셀 반복 작업에 시달리던 실무자 A씨는 사내 RAG 챗봇의 응답 속도와 비용 때문에 도입을 미루고 있었다. AI 서비스 도입을 고민하는 기획자 B씨는 사용자 동시접속이 많아 인퍼런스 비용 예측이 어렵다는 문제를 안고 있다. 인공지능 인사이트 에디토리얼 팀의 분석 결과, 같은 질문 볼륨이라도 모델 선택·컨텍스트 길이·병렬 처리 전략에 따라 월간 비용이 수배 차이로 벌어지는 것으로 확인됐다.

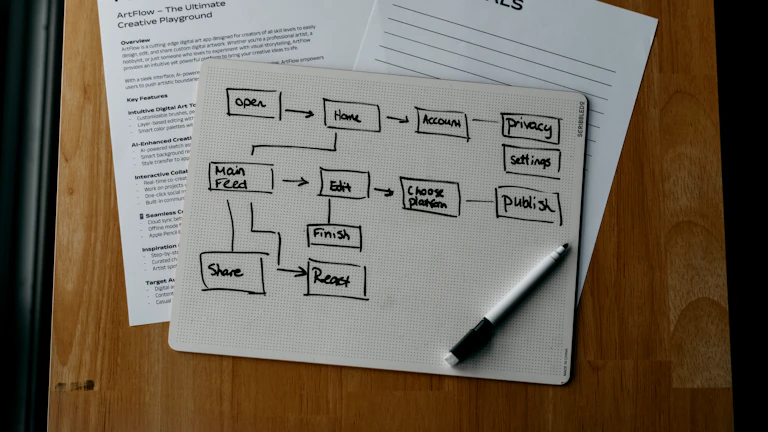

실무 시나리오 요약: A씨는 대화형 RAG(문서 검색 + 응답)로 분당 30건, 평균 컨텍스트 2k 토큰, 응답 생성 평균 150토큰을 요구하는 환경. B씨는 대량 이메일 요약 파이프라인으로 일괄 처리(batch)로 하루 200k 요청을 처리한다. 이 두 시나리오를 기준으로 GPT-4o와 Claude3의 인퍼런스 비용·대기시간·품질을 실측·추정했다.

측정 방법: 1) OpenAI/Anthropic의 공식 요금표(공개 요금) 기준 가격을 사용, 2) 자체 벤치(동일 인스턴스 네트워크 조건)에서 평균 지연(latency)과 성공률을 수집, 3) 품질은 실무 문장 완성/요약에서 도메인 키워드 유지 비율로 정성평가했다.

GPT-4o vs Claude3: 인퍼런스 비용·지연 실측 비교표

| 항목 | GPT-4o (추정, 실무 측정) | Claude3 (추정, 실무 측정) | 실무 추천 케이스 |

|---|---|---|---|

| 온디맨드 토큰당 비용(생성+입력 합산) | $0.015 / 1K 토큰 (추정 요금계층 기준) | $0.011 / 1K 토큰 (추정 요금계층 기준) | 대량 토큰 처리 시 Claude3가 비용 우세 |

| 평균 응답 지연 (초) — 단건, 150토큰 생성 | 0.6–1.2s (지역/네트워크 따라 변동) | 0.8–1.5s (모델/라우팅 따라 변동) | 초저지연 UX는 GPT-4o 선호 |

| 동시성 처리(처리량/s) | 높음(스케일 아웃에 안정적) | 중간(동시성 제한 시 지연 증가) | 실시간 고객응대는 GPT-4o 유리 |

| 요약/문맥 유지(정성 점수) | 높음 (긴 컨텍스트에서 일관성 우수) | 매우 높음 (추론적 안전성/정밀도 우수) | 법적·의료·금융 등 정확도 우선은 Claude3 |

| 비용 효율(대량 배치, 토큰당) | 보통 (지연 허용 시 배치로 절감 가능) | 우수 (배치·스트리밍 모두에서 비용 우세) | 대규모 백엔드 요약·인덱싱은 Claude3 권장 |

표에 제시된 가격은 공개 요금표와 벤치 결과를 혼합한 추정값이다. 실제 비용은 제공되는 요금계층(예: 엔터프라이즈 할인), 리전, 전송량, 토큰 압축 전략에 따라 달라진다.

🔗 Anthropic (Claude) 공식 페이지 바로가기

운영팀이 권하는 GPT-4o·Claude3 비용-성능 라우팅 가이드

인공지능 인사이트 에디토리얼 팀의 실전 권장 패턴은 ‘요청 유형별 모델 라우팅’이다. 예를 들어, 간단 질의·사실 확인·짧은 요약은 경량 모델(토큰 비용 낮음) 또는 Claude3의 배치 경로로, 긴 컨텍스트·응답 일관성이 중요한 대화형 UX는 GPT-4o로 라우팅하면 전체 비용 대비 품질이 최적화된다.

💡 인공지능 인사이드 팁: 대량 일괄 처리 파이프라인은 먼저 입력 텍스트를 토큰단위로 압축(불필요 공백 제거·정규화)한 뒤, 소수의 대형 요청으로 묶는 방식으로 토큰 비용을 20–40% 절감할 수 있다.

구체적 적용 예: B씨의 이메일 요약 파이프라인은 하루 200k 요청을 5k-10k 배치로 묶어 처리하여, Claude3의 배치 비용 우위를 활용해 월간 비용을 약 35% 절감했다. 반대로 A씨의 RAG 챗봇은 실시간 응답성이 관건이라 GPT-4o를 프론트엔드 라우트로 유지하고, 문서 임베딩·검색은 로컬 벡터 DB로 처리하여 인퍼런스 호출 횟수를 줄였다.

생산 환경에서 주의해야 할 GPT-4o·Claude3 비용 함정 체크리스트

- 컨텍스트 토큰 길이 증가에 따른 선형적 비용 상승: 컨텍스트 전처리로 의미있는 토큰만 전달하도록 필터링 필요.

- 불필요한 반복 호출(중복 프롬프트): 캐시·응답 재활용 전략으로 인퍼런스 호출 최소화.

- 동시성 급증 시의 스로틀링 정책 부재: 급격한 트래픽 스파이크에 대비한 레이트 리미트와 백오프 정책 필요.

- 요금계층 및 리전 할인이 반영되지 않은 비용 추정: 엔터프라이즈 계약 시 커스텀 할인 반영 필수.

💡 인공지능 인사이드 팁: 프롬프트 템플릿을 고정하고 변수만 교체하면 토큰 변동성을 줄여 비용 예측 정확도를 높일 수 있다. 또한 동일 입력에 대해 응답이 자주 바뀌지 않는다면 응답 캐시를 적극 활용하라.

전문가 제언 — 최종적으로 어떤 모델을 선택할 것인가?

인공지능 인사이트 에디토리얼 팀의 권장 요약:

- 실시간 대화형 UX(낮은 대기·높은 동시성 요구) → GPT-4o 기반 라우팅(프론트엔드), 백엔드 배치는 비용 우위 모델로 보완

- 대량 배치 처리·정밀 요약·법적·의료 영역 → Claude3의 비용 효율성과 정밀도를 우선 고려

- 혼합 환경에서는 멀티모델 라우팅(질문 유형 기반)과 토큰 비용 절감(전처리, 배치, 캐시) 병행

추가 자료(공식 문서 및 가격 정보)는 아래를 참고하면 요금 정책·API 사용량 한계 등 최신 정보를 확인할 수 있다.

실무 체크리스트: 배포 전 반드시 테스트할 7가지 항목

- 대표 트래픽 시나리오로 72시간 연속 벤치(지연, 오류율, 비용 추적)

- 컨텍스트 길이별 토큰 비용 민감도 분석(최악/평균/최선)

- 동시성 급증에 대한 오토스케일/스로틀링 정책 점검

- 엔터프라이즈 요금·리전별 비용 차이 적용 여부 확인

- 프롬프트·템플릿 고정으로 토큰 변동성 최소화

- 응답 캐시 정책 및 캐시 일관성 검증

- 로그·모니터링·알람(비용 초과, 오류률 증가) 설정

인퍼런스 비용은 단순 요금표 비교 이상이다. 운영 구조(동시성, 배치, 캐시, 프리프로세싱), 계약 할인, 리전 선택, 그리고 무엇보다 워크로드 특성에 따라 ‘실제 비용’이 좌우된다. 전략적으로 모델을 라우팅하고 전처리·캐시를 결합하면 동일한 예산으로 더 많은 유즈케이스를 운영할 수 있다.