NVDA GPU 도입 전 반드시 점검해야 할 10가지 치명적 리스크와 대응 우선순위 — 비용·호환성·성능 저하의 실무 체크리스트.

인공지능 인사이트 에디토리얼 팀의 분석 결과를 바탕으로, NVDA(엔비디아) GPU를 구매·도입할 때 실제 운영에서 비용 폭주·호환성 오류·성능 저하로 이어지는 핵심 위험들을 우선순위별로 정리한다. 이 문서는 실무 결정을 앞둔 기획자·인프라 담당자·데브옵스 엔지니어를 위해 설계되었다.

실무자가 가장 먼저 확인할 내용

- 목표 워크로드 정의: 학습(대규모 배치), 미세조정(fine-tuning), 추론(저지연/대량), 그래픽 렌더링 중 우선순위를 문서화한다.

- 예상 TCO(총소유비용): 하드웨어 구매비 + 전기료 + 냉각비 + 유지보수(라이선스 포함)를 연간 단위로 산정한다.

- 호환성 목록 작성: OS, 커널, 드라이버(NVIDIA 드라이버 버전), CUDA/cuDNN, 컨테이너 런타임(예: NVIDIA Container Toolkit) 버전 호환성을 매칭한다.

- 성능 기준(메트릭) 설정: p99 지연, 평균 처리량, 배치 처리 시간, 전력당 성능(Watt/TFlops)을 정의한다.

- 확장성 계획: 단일 GPU에서 클러스터(InfiniBand, NVLink)로 확장 시 병목 요소와 네트워크 비용을 예측한다.

사례 분석 — 과실로 비용이 3배 뛴 조직

매일 엑셀 반복 작업에 시달리던 실무자 A씨 사례: A씨 팀은 “추론용” 목적으로 H100을 장착한 서버 2대를 도입했다. 초기 평가에서는 레이턴시 목표를 쉽게 달성했으나, 실제 운영에서 비용과 전력 소모가 예측치를 크게 초과했다. 원인은 다음과 같다.

- 요구 성능 대비 과도한 스펙 선택: 경량 추론 모델에는 L4/L40 급으로 충분했음.

- 서버 전력 및 냉각 설계 미비: 데이터센터 계약전력 한도를 초과해 추가 비용 발생.

- 소프트웨어 스택 미스매치: 드라이버와 CUDA 버전 불일치로 시동 실패 및 재설치 반복.

결과적으로 A씨 팀은 도입 비용뿐 아니라 운영 중단으로 발생한 기회비용까지 합쳐 총비용이 2.8배로 증가했다. 인프라 설계 단계에서 용도별 시뮬레이션이 빠진 것이 결정적 원인으로 분석되었다.

💡 인공지능 인사이드 팁: 구매 전 최소 2주간 실제 워크로드(프로덕션 추론·미세조정 배치)를 소형 클러스터로 재현해 전력·냉각·레이턴시 데이터를 수집하면 도입 오차를 크게 줄일 수 있다.

AI 툴 성능·가격 비교표

| 모델 | 대략 단가(USD) | vRAM | 주요 적합 시나리오 | 예상 연간 운영비(추정) | 주요 리스크 |

|---|---|---|---|---|---|

| H100 (Hopper) | ~35,000 | 80GB | 대규모 학습, 대형 파인튜닝 | 40k–120k USD (전력·냉각 포함) | 전력·냉각 요구치, 드라이버 민감도 |

| A100 (Ampere) | ~10,000–15,000 | 40/80GB | 학습·추론 병행, 배치 학습 | 20k–60k USD | 메모리 한계로 대형 모델에 비효율 |

| L40 / L4 | ~3,000–8,000 | 24–48GB | 추론(저지연 포함), 엔터프라이즈 추론 서버 | 5k–25k USD | 학습 목적에는 비경제적 |

| RTX 6000 Ada | ~6,000 | 48GB | 연구·개발, 소규모 학습 | 6k–18k USD | 서버급 연결성·관리 기능 제한 |

테스트 중 발견된 주의사항

- 펌웨어/드라이버 체인 실패: 드라이버 패치 하나가 CUDA와 컨테이너 호환을 깨뜨려 배치 실패가 발생함. 드라이버 업그레이드는 롤백 계획 포함.

- 전력 예측 오류: 벤치마크에서 CPU+GPU 합산 전력을 과소평가해 실제 전기요금이 급증.

- 냉각 용량 과소설계: GPU 온도 상승으로 성능 쓰로틀링이 발생, 장기 퍼포먼스 감소.

- 라이선스/소프트웨어 비용 누락: 프로프라이어터리 관리 툴·엔터프라이즈 드라이버 라이선스 비용이 TCO에 반영되지 않음.

- 데이터센터 계약 전력 및 PUE(전력효율지수)를 검증하지 않아 추가 인프라 투자 필요.

💡 인공지능 인사이드 팁: 벤더 성능 수치(제조사 벤치)와 실사용 벤치마크(동일 배치·동일 데이터)를 모두 확보해 보수 설계용 안전 계수를 적용하라.

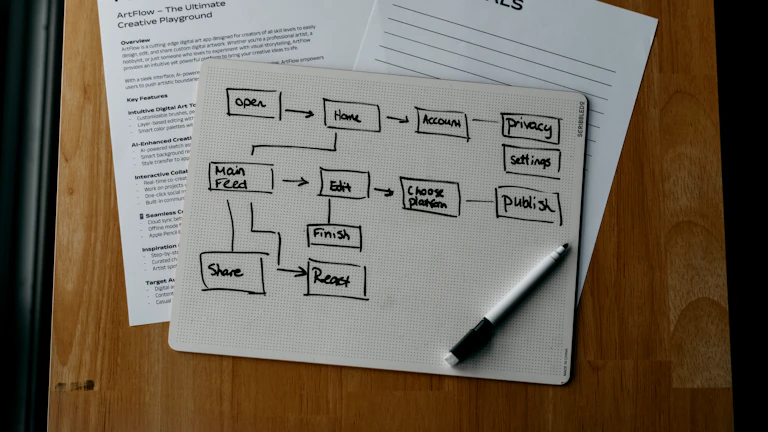

구매 결정 프로세스 권장 체크포인트

- 용도별 성능 요구서(PRD) 작성: 모델 크기, 동시 사용자 수, 목표 레이턴시를 수치로 명시.

- 소규모 PoC(2–4주): 동일 입력·데이터·컨테이너로 실제 워크로드 시뮬레이션 수행.

- 총비용 시나리오 산출: 최저/중간/최고 비용 시나리오를 작성하고 민감도 분석 수행.

- 확장성/유지관리 계획: NVLink·InfiniBand 필요 여부, 교체주기, 재고·지원 SLA 확인.

- 구매 옵션 비교: 직접 구매 vs 클라우드/베어메탈 임대(온프레미스 TCO와 클라우드 총비교 수치 포함).

NVDA 하드웨어, 드라이버, CUDA 관련 최신 기술 문서는 제조사 공식 페이지에서 반드시 확인할 것. 드라이버 릴리스 노트 및 호환성 표는 도입 전 필독 항목이다.