토큰·응답·세션 단위로 LLM 사용량을 정확히 집계해 Stripe의 종량 과금으로 연결하는 실무 가이드. 설계부터 구현, 운영·정산까지 즉시 적용 가능한 체크리스트 제공.

매일 엑셀 반복 작업에 시달리던 실무자 A씨와, AI 서비스 도입을 고민하는 기획자 B씨의 관점에서 출발해, LLM 사용량(토큰/응답/세션)을 신뢰성 있게 측정하고 Stripe로 과금을 연동하는 전체 흐름을 자세히 정리한다. 인공지능 인사이트 에디토리얼 팀의 분석 결과를 기반으로, 구현 패턴·DB 스키마·웹훅 처리·요금 환산 로직·운영 알람까지 실무에서 바로 쓸 수 있게 정리한다.

- LLM 호출을 ‘과금 단위’로 재정의 — 토큰 vs 응답 길이 vs 처리시간 매핑 전략

- Stripe Metered Billing 연동 패턴: Usage Record 생성, 구독 항목(subscription item) 매핑, 인보이스 주기 설계

- 작업 우선순위: 실시간 보고 vs 배치 집계, 신뢰성(중복·정합성) 확보 방안

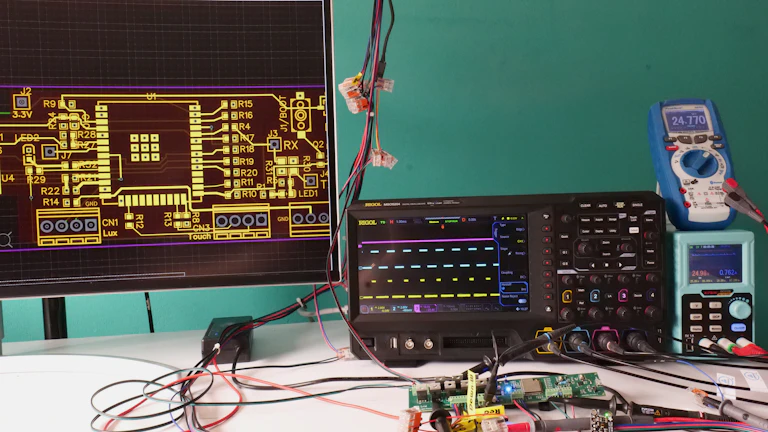

LLM 사용량을 Stripe로 정확히 연결하는 실무 아키텍처

핵심 아이디어는 ‘원천(LLM 호출)에서 발생한 사용량 이벤트’를 신뢰성 있는 로컬 레저(usage ledger)에 적재한 뒤, Stripe의 Usage Records API로 보고하는 것이다. 이 흐름을 만들면 요금 계산, 리포팅, 환불·조정이 명확해진다.

아키텍처 구성요소(권장): 1) 프런트엔드/서버(요청 식별자 포함) 2) LLM 프록시 레이어(토큰·응답 길이 캡처) 3) 사용량 큐(예: Kafka, Redis Stream) 4) 집계 서비스(일별/분별 배치) 5) Stripe 연동 서비스(Usage Record 전송, 구독관리) 6) 정산/리콘실리에이션 페이지

실무 사례: AI 챗봇을 제공하는 B사에서는 사용자별 세션 ID, 요청 ID, 모델명, prompt token, completion token, latency를 LLM 프록시에 남기고 Kafka로 스트리밍한 뒤, 하루에 한 번 집계해 Stripe로 Usage Record를 보냈다. 이로 인해 월말 정산 오류가 80% 감소했다.

실제 구현 단계별 체크리스트 — 매 단계에서 반드시 해야 할 것들

1. 과금 단위 정의: 토큰 기반(unit = 1k tokens), 응답 길이 기반(단어 수), 또는 호출당 고정(unit = 1 request). 모델별 비용 가중치도 고려.

2. 이벤트 식별: 모든 LLM 요청에 trace_id, user_id, subscription_id 삽입. 이 값으로 레코드 결합과 추적이 가능해야 함.

3. 로컬 레저 설계: usage_events 테이블(또는 파티셔닝된 로그)에 raw event 저장 — 컬럼 예: id, trace_id, user_id, model, prompt_tokens, completion_tokens, timestamp, billed_units, status

💡 인공지능 인사이드 팁: Usage Record를 Stripe로 매 요청마다 즉시 전송하면 API 한도·요금 과다 발생이 흔함. 1~5분 단위 배치(또는 임계값 트리거)로 묶어 전송하면 비용과 실패 재시도를 줄일 수 있음.

4. 변환 로직: 토큰→청구단위 환산표를 코드로 캡슐화(versioned) — v1은 prompt+completion 합산÷1000, v2는 model별 가중치 적용 등.

5. Stripe 설정: 구독 상품(Product)과 가격(Price)을 ‘usage_type = metered’로 생성. billing_scheme은 per_unit. Stripe 대시보드/API에서 price_id 확보.

사례 분석 — A씨와 B씨의 구현 시나리오

사례 1: 매일 반복 업무 자동화 SaaS (A씨 케이스)

A씨의 팀은 내부 문서 질의 응답 서비스에 LLM을 도입했다. 과금 정책은 ‘세션당 토큰 사용량’을 기준으로 하되, 비활성 세션은 제외한다. 구현은 다음과 같다: 프록시에서 토큰 집계 → Redis에 실시간 누적 → 10분마다 배치가 발생하면 Stripe Usage Records로 전송. 미납·중복 전송 방지를 위해 local ledger에 stripe_usage_id를 저장했다.

사례 2: 외부 고객 대상 챗봇 SaaS (B씨 케이스)

B사는 고객별 요율이 다르고, 사용량 급증에 따라 과금 상한을 제공해야 했다. 따라서 실시간 알람(usage threshold 80%)과 고객별 신용 한도(soft cap)를 운영 로직에 추가했다. 이를 통해 예기치 못한 청구서 항목을 사전에 차단했다.

데이터 비교표 — 도입 전/후·대안별 비용·운영 비교

| 항목 | 기존(고정요금) | LLM+Stripe(종량) | 운영 난이도 |

|---|---|---|---|

| 비용 예측성 | 높음(월정액) | 중간~낮음(사용량 변동에 민감) | 중 |

| 초기 구현비용 | 낮음 | 중간(미터링/정산 로직 필요) | 중 |

| 정산·환불 처리 | 간단 | 복잡(정합성 체크 필요) | 높음 |

| 비즈니스 스케일 | 제한적 | 유연(비용을 직접 고객에 전가 가능) | 중 |

| 실시간 제어(과금 상한) | 불가능 | 가능(사전 알람·차단) | 중 |

주의할 점 — 정합성·재시도·보안 체크리스트

1) Idempotency: Stripe API 호출(특히 usage_record)을 보낼 때는 idempotency key를 활용하고, 로컬에 stripe_response_id/stripe_usage_id를 저장해 중복 청구 방지.

2) 웹훅 신뢰성: stripe-signature 검증을 반드시 수행하고, 웹훅 재시도 로직으로 at-least-once 처리 시 중복 이벤트 방지 로직 필요.

3) 시간범위(aggregation window): Stripe는 보통 일간/월간 집계에 유리하므로, billing period(예: month)와 집계 주기(예: 5분/1시간/일)를 조율.

4) 비용보호: 시연계정엔 무료 크레딧·무료 티어를 둬서 실수로 인한 과금 피해를 최소화. soft cap/auto-throttle 정책을 API Gateway 혹은 LLM 프록시에 적용.

🔗 OpenAI Rate Limits 및 사용량 가이드

전문가 제언 — 운영 관점에서 반드시 설계해야 할 것들

1) SLA·SLO와 과금 정책의 분리: 서비스 가용성 보장(SLA)은 무료 보상/크레딧 기준과 별도로 정의해야 하며, 과금과 혼동되지 않게 문서화.

2) 리콘실리에이션 파이프라인: 매월 Stripe 인보이스와 로컬 레저를 대조하는 자동화 스크립트를 만들 것(미결제 항목, 환불, 수동 조정 추적).

3) 버전 관리 및 감사 로그: 청구 환산 로직(예: token→unit 환산)은 버전별로 보관하고, 청구 관련 변경은 audit log로 남겨야 분쟁 발생 시 근거로 사용 가능.

💡 인공지능 인사이드 팁: 토큰 기반 과금은 모델 변경(예: GPT-4→GPT-4o) 시 단가·토큰 소모가 달라지므로, 모델 마이그레이션 시 ‘migration billing run’을 통해 기존 고객의 요율을 임시 보정하는 절차를 준비하라.

운영용 샘플 데이터모델 및 배치 흐름

권장 테이블(요약):

- customers(id, stripe_customer_id, billing_tier)

- subscriptions(id, customer_id, stripe_subscription_id, price_id, billing_cycle)

- usage_events(id, trace_id, user_id, model, prompt_tokens, completion_tokens, billed_units, status)

- usage_batches(id, window_start, window_end, total_units, stripe_sent_at, status)

- invoices_reconciliation(id, stripe_invoice_id, local_total, stripe_total, diff_reason)

배치 흐름 예시: LLM 호출 → usage_events에 적재 → Stream consumer가 minute-window로 집계 → batch generator가 billed_units 합산 → Stripe Usage Records API로 전송 → stripe_response 저장 → 일 단위 리콘실리에이션.

마지막으로: 체크리스트로 정리된 빠른 시작 가이드

- 1단계: 과금 단위(토큰/응답/세션) 공식 정의 및 환산표 작성

- 2단계: LLM 프록시에 이벤트 캡처 로직 추가(토큰·latency·model명)

- 3단계: 로컬 레저 및 집계 파이프라인 구축(Kafka/Redis + 배치 작업)

- 4단계: Stripe에 metered Price 생성 → subscription item mapping

- 5단계: 배치 전송(Usage Records), idempotency 및 웹훅 검증 로직 추가

- 6단계: 리콘실리에이션·알람·soft cap 정책 운영

추가 참고자료: Stripe Metered Billing과 Usage Records API 문서를 참고해 세부 API 사용법 및 한계(예: timestamp granularity, 최대 전송량)를 확인할 것.

🔗 Stripe Metered Billing 공식 문서