LangChain을 중심으로 한 MLOps 파이프라인 설계부터 Kubernetes 배포, 모니터링·알림·비용 최적화까지 실무에서 바로 적용 가능한 체크리스트와 비교표를 모두 정리.

인공지능 인사이트 에디토리얼 팀의 분석 결과를 토대로, LangChain을 활용해 프로덕션 환경에 LLM 기반 서비스를 안전하고 경제적으로 운영하는 실무 노하우를 정리한다. 이 글은 기획자, 엔지니어, DevOps 담당자가 당장 적용 가능한 단계별 가이드를 제공한다.

- LangChain 기반 서비스는 오케스트레이션·에이전트 로직 분리로 배포·모니터링이 용이하다.

- 프로덕션 핵심: 모델 라우팅·추적(Tracing)·비용 제어를 설계 단계에서 확립해야 실패를 줄인다.

- 모니터링은 요청별 메타정보(콘텍스트 길이, 벡터 DB 조회, 토큰 사용량)를 집계하는 것이 핵심이다.

사례로 풀어보는 LangChain MLOps: 엑셀 반복 작업을 줄인 A씨의 여정

매일 엑셀 반복 작업에 시달리던 실무자 A씨는 내부 문서 기반 자동응답(RAG) 챗봇을 도입했다. 초기 PoC는 로컬 스크립트와 cron 조합으로 운영했지만, 트래픽이 증가하며 지연·비용·버전 관리 문제가 발생했다.

인공지능 인사이트 에디토리얼 팀의 권장 아키텍처는 LangChain으로 비즈니스 로직(프롬프트 템플릿, 체인/에이전트 정의)을 코드화하고, 모델 호출·데이터 저장·로그·모니터링을 분리하는 것이다. 이 구조는 다음 장점이 있다: 재현 가능한 체인 실행, 모델 교체 시 리스크 감소, 에이전트 상태의 외부화.

구체적 도입 단계: (1) LangChain으로 체인 및 에이전트 구성, (2) 벡터 DB(예: Pinecone/Weaviate/Chroma)로 문서 인덱싱, (3) 모델 라우터(동적 라우팅 매커니즘)로 비용·레이턴시 기준 모델 선택, (4) Kubernetes에 컨테이너화하여 HPA/PodDisruptionBudget 적용, (5) Prometheus/Grafana + OpenTelemetry로 분산 추적 및 경보 설정.

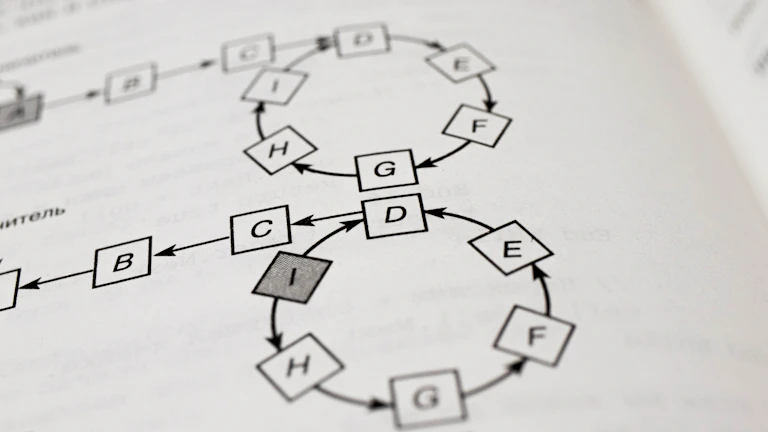

실무에서 흔히 발생하는 문제: 벡터 DB 조회에 소요되는 시간과 토큰 사용량의 상호작용, 외부 API(예: OpenAI) 호출 실패 시 롤백 정책 부재, 에이전트가 무한 루프에 빠지는 케이스 등. 이러한 문제는 설계 단계에서 타임아웃·재시도·정상화 정책을 포함하면 상당 부분 완화된다.

구체적 예시 — A씨 팀은 LangChain의 Callback 시스템을 이용해 모든 체인 실행마다 메타 데이터를 수집했다. 수집 항목: 호출 모델, 입력 토큰/출력 토큰 수, 벡터 조회 수, 체인 단계별 지연시간, 에러 코드. 이 데이터를 기반으로 SLA·SLO를 설정해 알림을 걸었다.

LangChain MLOps 우선순위: 운영팀이 먼저 점검할 7가지

인공지능 인사이트 에디토리얼 팀은 프로덕션 전 점검항목을 우선순위로 정리한다. 핵심은 Observability(가시성), Reliability(신뢰성), Cost(비용) 세 축이다.

우선순위 체크리스트:

- 메트릭 수집 범위 정의(토큰 비용, 모델별 요청 건수, 벡터 조회 횟수, 평균 응답시간)

- 샘플링 기반 트레이스 수집(모든 요청이 아닌 비율로 추적 데이터 저장)

- 모델 라우팅 정책 설정(요청 유형·비용 기준으로 모델 선택)

- 에이전트 실행 안전장치(스텝 카운트 제한, 재귀 호출 제한, 실행 타임아웃)

- 데이터 프라이버시·DLP 연동(민감정보 식별 및 마스킹)

- 테스트 환경에서의 비용 시뮬레이션(프로덕션 유입 전 월 예상비용 모델링)

- 배포 롤백·버전 관리(체인/에이전트 코드와 프롬프트 템플릿을 버전화)

💡 인공지능 인사이드 팁: 모든 체인 호출에 대해 Callback 로그(입력 토큰, 출력 토큰, 벡터 조회)를 JSON으로 표준화해 수집하면 비용 분석과 원인분석이 3배 이상 빨라진다.

현장용 LangChain MLOps 성능·비용 비교표

위 수치는 조직 규모·트래픽·모델 선택에 따라 편차가 크다. 인공지능 인사이트 에디토리얼 팀 권장 방법은 초기 규모에서 비용 시뮬레이션을 거쳐 모델 라우팅 룰을 점진적으로 강화하는 것이다.

운영 중 흔히 놓치는 LangChain MLOps 주의 포인트

다음은 프로덕션 운영에서 자주 간과되는 항목과 권장 대응이다.

- 토큰·벡터 비용 집계 미비 — 해결: 요청별 비용 태깅 및 일/월 집계 대시보드 구성

- 에이전트의 비결정성(Non-determinism) — 해결: 중요 트랜잭션에 대해 deterministic 모델 버전 고정 및 A/B 실험 설계

- 외부 API 호출 실패 대비 미흡 — 해결: 회로 차단기(Circuit Breaker)와 백오프 전략 적용

- 프롬프트 드리프트(입력 데이터 변화로 인한 성능 하락) — 해결: 성능 모니터링과 주기적 리프레시(예: 인덱스 재생성)

- 데이터 유출 가능성 — 해결: DLP 연동, 민감정보 패턴 기반 필터링

운영 알림(Incident Alert) 설계 예시: 토큰 비용이 하루 예산의 20%를 초과하거나, 응답 지연시간 p95가 SLA를 넘을 경우 PagerDuty/Slack으로 즉시 알림 발송.

💡 인공지능 인사이드 팁: 트래픽이 낮은 구간에 배치된 기간(예: 야간)에 모델을 리-프리핑(re-prefill)해 캐시 히트율을 높이면 급격한 트래픽 상승에도 지연을 억제할 수 있다.

아래는 실무 적용 체크리스트(요약). 프로덕션 도입 전 이 9가지를 통과시키는 것이 권장된다.

- 프롬프트·체인 코드의 버전관리(Git + CI 테스트)

- 모델 라우팅 정책(비용·레이턴시 기준)

- 토큰·벡터 사용량 모니터링 및 경보

- 에이전트 실행 제한(스텝/시간/메모리)

- 분산 추적(OpenTelemetry)과 메트릭(Prometheus)

- 캐시·배치 처리 설계로 비용 최적화

- DLP 연동 및 민감정보 마스킹

- 롤백·블루/그린 배포 전략

- 비용 시뮬레이션 및 월별 예산 알림

추가로 참조할 공식 가이드와 도구 문서를 통해 초기 도입 리스크를 줄이길 권장한다.